适用于所有企业的人工智慧推论与主流运算技术

运用NVIDIA A30 Tensor核心GPU,为各种企业工作负载提供加速效能。这款GPU搭载NVIDIA Ampere架构Tensor核心与多执行个体GPU (MIG),可安全地加速各种工作负载,包括大规模人工智慧推论和高效能运算(HPC)应用程式。A30采用PCIe规格,结合快速记忆体频宽和低耗能的优点,是主流伺服器的最佳选择,可建立弹性资料中心,并让企业发挥最大价值。

深度学习训练

● 训练人工智慧模型处理更高一级的挑战(如对话式人工智慧),需要极强大的运算和扩充能力。

● 若使用精度为Tensor Float (TF32)的NVIDIA A30 Tensor核心 可在完全不变更程式码的情况下,提供比NVIDIA T4高10倍的效能,若使用自动混合精度和FP16,还可进一步将效能提高2倍,且记忆体输送量总共提升20倍。与NVLink ®、第四代PCIe、NVIDIA网路和NVIDIA Magnum IO ™ SDK搭配使用时,还可以扩充到使用数千个GPU。

● Tensor 核心和MIG 让A30 能够全天动态应用于工作负载。A30 可在需求达到高峰时用于产生推论,而部分GPU 可以重新调整用途,在离峰期间快速重新训练这些相同的模型。

● NVIDIA在人工智慧训练的业界级基准测试 MLPerf中,创下多项效能记录。

深度学习推理

● A30 带来创新功能以最佳化推论工作负载。从FP64、TF32 到INT4,加速整个精度范围。A30 每个GPU 最多可支援四个MIG,让多个网路能够在安全的硬体分割区中同时运作,且具有服务品质保障(QoS)。除了A30 提升的其他推论效能以外,结构化稀疏支援可提供高达2 倍的效能。

● NVIDIA领先业界的人工智慧效能已在 MLPerf推论.中得到证实。A30结合了NVIDIA Triton ™推论伺服器轻松就能大规模部署人工智慧,可为各企业带来突破性效能。

高性能计算

● 为了推进新一代的发现,科学家需要模拟技术以更透彻地了解我们周围的世界。

● NVIDIA A30 搭载FP64 NVIDIA Ampere 架构Tensor 核心,自GPU 问世以来,在高效能运算方面达到了最大进展。此外还结合了24GB 的GPU 记忆体和每秒933GB (GB/秒) 的频宽,让研究人员可以快速解决双精度计算的问题。在执行单精度的密集矩阵乘法作业时,高效能运算应用程式还可以利用TF32,提供更高的输送量。

● 藉由结合FP64 Tensor 核心和MIG,研究机构便能安全地分割GPU,让多名研究人员能够使用运算资源,确保服务品质保障(QoS) 并达到最高的GPU 使用率。部署人工智慧的企业可以在需求达到高峰时使用A30 的推论功能,然后在离峰期间将相同的运算伺服器重新用于高效能运算和人工智慧训练工作负载。

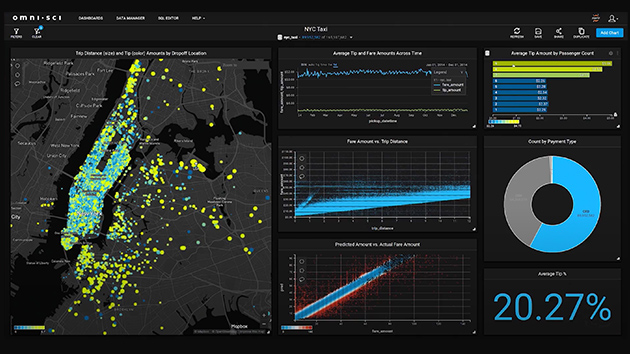

高效能资料分析

● 资料科学家要能够分析、视觉化,并将庞大资料集转换成深入分析。但是,由于这些资料集分散在多个伺服器上,经常无法实行扩充解决方案。

● 使用A30的加速伺服器同时搭载大型HBM2记忆体、每秒933GB (TB/秒)的记忆体频宽以及 NVLink —的扩充能力,可提供处理这些工作负载所需的运算能力。NVIDIA资料中心平台结合了NVIDIA InfiniBand、NVIDIA Magnum IO 以及RAPIDS ™开放原始码函式库套件,包括适用于Apache Spark的RAPIDS加速器,能够以前所未有的效能与效率,加速这些庞大的工作负载。

强川科技 — 专业IT综合服务提供商 【业务领域:计算机硬件、系统软件、系统集成、IT运维外包】

成都强川公司英伟达/NVIDIA产品销售团队经过多年深耕与发展,至今已成功助力超过数千家中小企业的成长。一直以来, 我们的几十位销售顾问和技术专家,坚持以倾听您的需求和愿望为工作核心,以丰富的方案经验、敏锐的行业洞察和过硬的IT技术,为您提供高匹配度的解决方案,帮您做出更明智的决定。

立即咨询

立即咨询